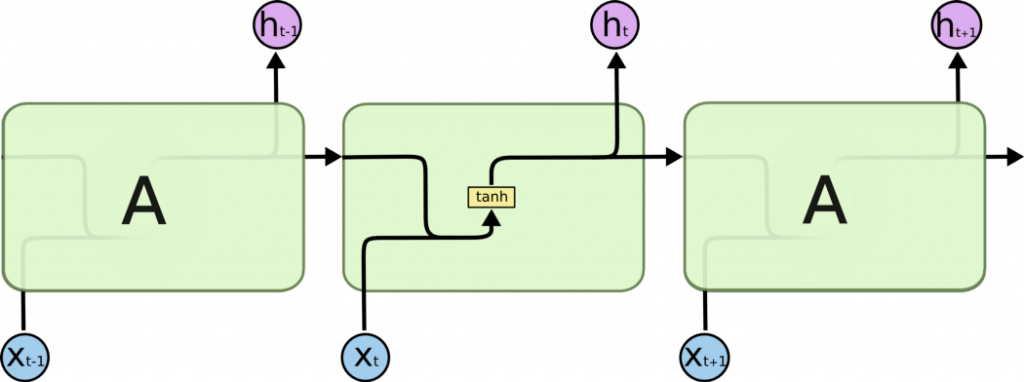

再看一次Simple RNN

圖中說明

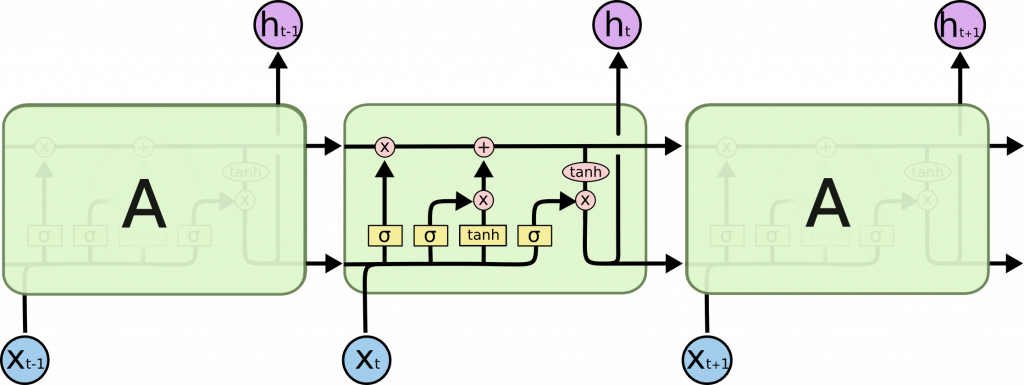

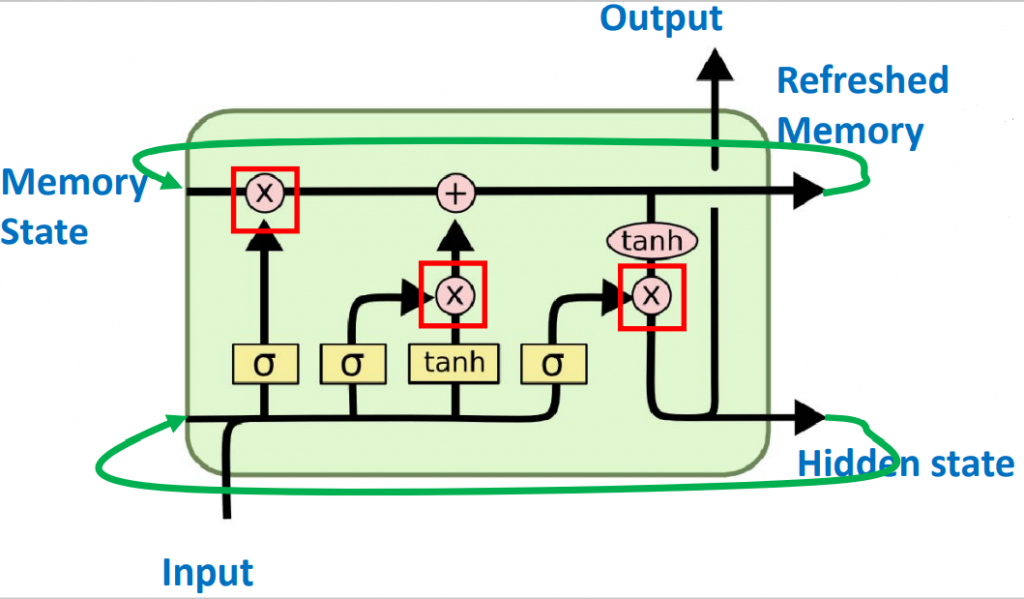

LSTM也具有這種鏈狀結構,但是重複模塊具有不同的結構。 而不是只有一個神經網絡層,而是有四個以非常特殊的方式進行交互。

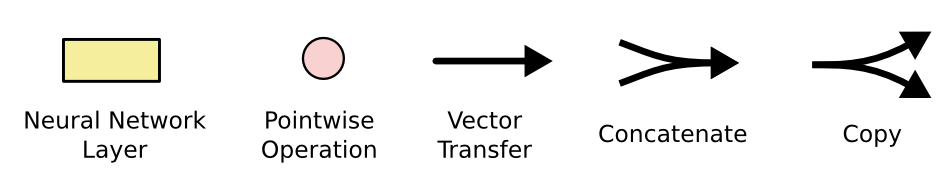

在上圖中,每條線都承載著整個向量(vector),從一個節點的輸出到另一個節點的輸入。 粉色圓圈表示逐點操作,如向量加法/乘法,而黃色框表示學習的神經網絡層。 合併的行表示串聯,而分叉的行表示要拷貝/複製的內容,並且副本到不同的位置。

LSTM 含長期及短期記憶

Cell(綠色框)的輸入不再是以前一個cell的輸出

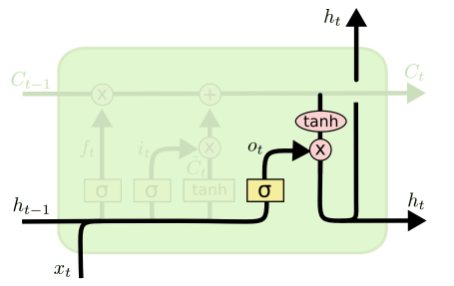

Cell內多了"gates",重點在"focus 焦點"、"forget 忘記"、"remember 記憶"。

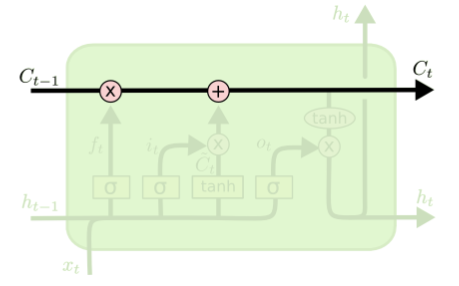

長期記憶

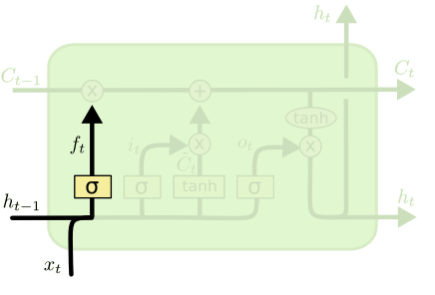

決定要保留成記憶或忘掉

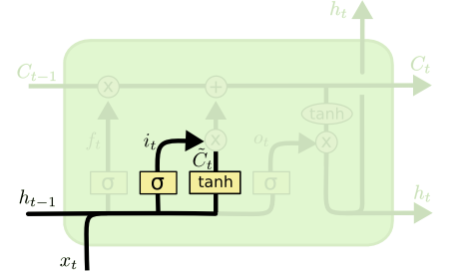

tanh 為真正輸入的值

短期記憶